ChatGPT-4 ha davvero passato il test di Turing? E cosa implicherebbe?

In uno studio conversazionale, l’ultima versione dell’intelligenza artificiale è risultata indistinguibile dagli esseri umani: è il “gioco dell’imitazione” ideato da Alan Turing, che però per alcuni non è attendibile

ChatGPT-4 (immagine dal profilo LinkedIn di Rex Technologies)

Pare proprio che ChatGPT-4, l’ultima versione del programma conversazionale basato sull’intelligenza artificiale, abbia superato il cosiddetto “test di Turing”. Un criterio per determinare se una macchina possa esibire un “comportamento intelligente”, proposto dall’eponimo matematico inglese oltre settant’anni fa. Che però, per alcuni, non è attendibile.

Il test di Turing

«Propongo di considerare la domanda: possono le macchine pensare?» Sono le parole con cui si apre Computing machinery and intelligence, articolo che costituisce la pietra miliare per eccellenza nel campo dell’informatica e dell’IA. Venne pubblicato nel 1950 sulla rivista Mind da Alan Turing, il “papà” dei moderni computer, che qui introdusse quello che chiamò “The Imitation Game”.

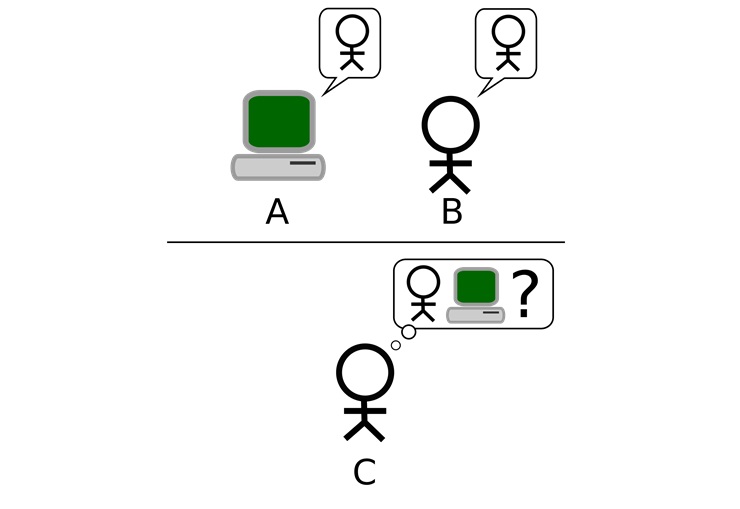

Nella descrizione originaria, esso prevede che un uomo A e una donna B siano tenuti separati da una terza persona C. La quale ha il compito di stabilire il sesso degli altri partecipanti sulla base delle loro risposte dattiloscritte (non necessariamente sincere) a una serie di domande.

A un certo punto, ad A viene sostituito un cervello elettronico, che ora C deve identificare. Se la percentuale di risposte corrette non cambia significativamente, per il genio londinese la macchina dovrebbe essere considerata intelligente, perché sarebbe indistinguibile da un essere umano.

ChatGPT-4 è indistinguibile da un essere umano

Ebbene, in un recente studio alcuni scienziati cognitivi americani hanno applicato un adattamento del test di Turing all’ultima versione del noto chatbot di OpenAI. La quale, come riporta Yahoo! News, è stata scambiata per un essere umano per ben il 54% delle volte. Dato che peraltro fa il paio con una precedente ricerca in cui il software, scrive l’AGI, aveva mostrato “tratti della personalità” sovrapponibili a quelli umani.

Questo significa quindi che ChatGPT-4 ha le nostre stesse abilità intellettive? Non necessariamente: per alcuni esperti, infatti, il “gioco dell’imitazione” è uno strumento ormai obsoleto, non (più) adatto a valutare le capacità di una tecnologia così avanzata. Esso infatti si limita a considerare gli output dell’algoritmo, ma non dice nulla sulla comprensione dei concetti né sull’intenzionalità, che (per ora) restano caratteristiche unicamente umane.

Nonostante gli innegabili progressi, dunque, la strada cibernetica è ancora fortemente in salita. Ma non ditelo ad “AI Steve”, avatar dell’imprenditore Steve Endacott e candidato indipendente, come riferisce Euronews, alle elezioni generali britanniche del prossimo 4 luglio. Ennesimo segno che, se è indubitabilmente vero che l’intelligenza artificiale presenta dei rischi, non è che quella naturale se la passi poi tanto meglio.